Donna paralizzata torna a parlare grazie a un avatar virtuale

Elettrodi e IA traducono i segnali del cervello in parole ed espressioni del volto.

[ZEUS News - www.zeusnews.it - 26-08-2023]

Una donna di 47 anni, Ann, che 18 anni fa è rimasta paralizzata e ha perso la capacità di parlare a causa di un ictus al tronco encefalico, ha ripreso a "parlare" attraverso un avatar virtuale che trasforma in suoni ed espressioni del viso i segnali provenienti dal suo cervello.

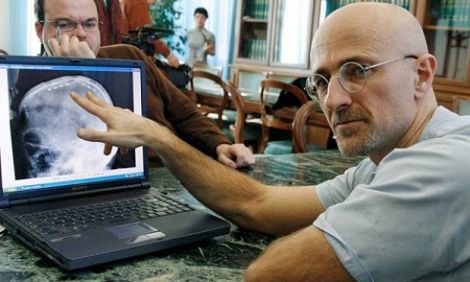

La tecnologia che ha permesso questo risultato, descritta in uno studio su Nature, è stata messa a punto dal team del professor Edward Change, dell'Università della California San Francisco.

«Il nostro obiettivo» - ha spiegato Chang raccontato dei traguardi ottenuti - «è ripristinare la piena facoltà di comunicare. Questi sviluppi ci hanno portato molto più vicini a rendere tutto ciò una soluzione reale per molti pazienti».

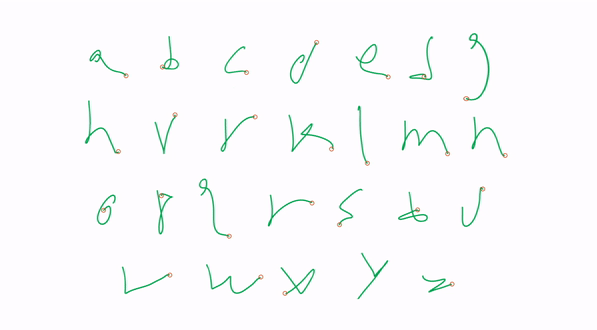

Il sistema usa 253 elettrodi impiantati sulla superficie del cervello di Ann, in una regione la cui importanza è fondamentale per parlare. Gli elettrodi intercettano i segnali che il cervello produce e che, se non ci fosse stato l'ictus, controllerebbero la lingua nonché i muscoli del volto, della laringe e della mandibola.

Una volta impiantati gli elettrodi, la donna ha affrontato un periodo di "addestramento" durante il quale la IA che governa la traduzione dei segnali in parole ha imparato - grazie alla ripetizione continua di certe frasi - a riconoscere i segnali specifici del cervello di Ann.

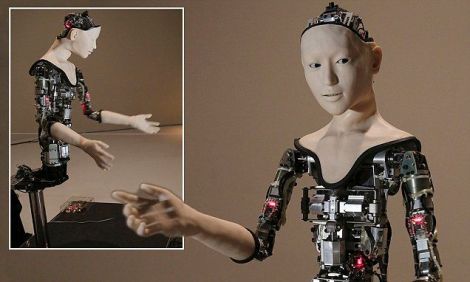

È nato così l'avatar di Ann, dotato di una voce che somiglia il più possibile a quella che la donna possedeva prima dell'ictus - ricostruita dalla registrazione del discorso tenuto al suo matrimonio - e che è dotato anche di un volto in grado di assumere diverse espressioni.

Il risultato è uno strumento che, sebbene non perfetto (la IA sbaglia a identificare la parola pensata da Ann il 28% delle volte) consente alla donna di comunicare al ritmo di 78 parole al minuto.

Anche se il sistema non consente di raggiungere la rapidità tipica del parlato naturale - che arriva a 110/150 parole al minuto - i progressi rispetto ai sistemi usati sinora da Ann per comunicare sono elevati: la tecnologia di eye tracking usata per assemblare lettere, parole e frasi le consentiva al massimo 14 parole al minuto.

«È un gran bel balzo rispetto ai risultati precedenti» ha commentato il professor Nick Ramsey, dell'Università di Utrecht. «Siamo a un punto di svolta».

L'obiettivo ora, oltre all'aumento della precisione, è creare una versione senza fili della medesima tecnologia, rendendo wireless la connessione tra il cervello e il computer su cui risiede la IA.

«Restituire la capacità di controllare liberamente computer e telefoni grazie a questa tecnologia avrebbe effetti profondo sull'indipendenza e sulle interazioni sociali delle persone» ha commentato il dottor David Moses, co-autore dello studio.

Qui sotto, il video dell'Università della California che illustra la ricerca.

|

Se questo articolo ti è piaciuto e vuoi rimanere sempre informato con Zeus News

ti consigliamo di iscriverti alla Newsletter gratuita.

Inoltre puoi consigliare l'articolo utilizzando uno dei pulsanti qui

sotto, inserire un commento

(anche anonimo)

o segnalare un refuso.

© RIPRODUZIONE RISERVATA |

|

Il computer che legge il cervello

Non era in coma ma i medici non gli credevano

Guidi male? La colpa è di un gene

Una "Seconda Vita" per chi è affetto da paralisi

Commenti all'articolo (1)

28-8-2023 14:13

|

|

||

|

- Al caffe' dell'Olimpo:

[GIOCO] Associazioni di idee - Telefonia fissa:

Disattivare il telefono (ma non Internet) con

Tiscali Fibra - Multimedia:

Convertire i video in immagini - Pronto Soccorso Virus:

DISDOWN.COM - Windows 11, 10:

Avvio Lentissimo pc - Social network:

web.whatsapp quanto è affidabile? - Browser:

Firefox non sincronizza le schede su pc desktop

perchè????? - Software - generale:

Alternative a Dropbox - Tablet e smartphone:

MEMORIA SAMSUNG GALAXY XCOVER SM-G390F - Linux:

Sondaggio prestazioni

zeross