Perché l'intelligenza artificiale ci seduce?

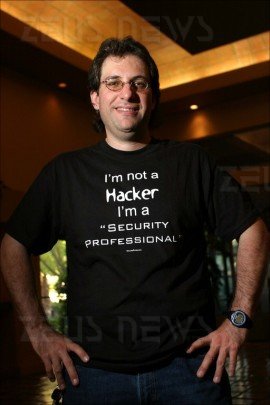

Lo spiega l'esperto mondiale Bruce Schneier.

- Articolo multipagina1 / 4

[ZEUS News - www.zeusnews.it - 16-05-2024]

È facile considerare l'intelligenza artificiale come nient'altro che l'ennesima novità tecnologica, uno strumento informatico in più, un ausilio al quale ci abitueremo presto. Nessuno si è agitato o ha proclamato la catastrofe sociale per l'introduzione del controllo ortografico o del riconoscimento vocale. Quindi perché così tanto clamore, e in alcuni casi panico, proprio intorno all'intelligenza artificiale?

L'esperto di sicurezza informatica Bruce Schneier, autore di numerosi libri sulle tematiche digitali e membro del direttivo della Electronic Frontier Foundation, una delle associazioni di punta nella tutela dei diritti digitali, ha pubblicato un saggio, intitolato AI and Trust, nel quale spiega molto bene questa anomalia partendo da un concetto sociale, non tecnologico: la fiducia. E spiega perché noi, come esseri umani, siamo particolarmente vulnerabili alla natura seducente dell'intelligenza artificiale.

Premessa: due tipi di fiducia da distinguere

"La fiducia", dice Bruce Schneier, "è essenziale per la società. Gli esseri umani, come specie, tendono a fidarsi gli uni degli altri." Prendiamo un mezzo pubblico o camminiamo per strada dando per scontato di poterci fidare del conducente di quel veicolo e del fatto che non verremo aggrediti dai passanti. La fiducia è l'impostazione di default della società, per così dire.E ci sono due tipi di fiducia: quella interpersonale, basata sulla conoscenza diretta di una persona, e quella sociale, basata sui meccanismi e sulle regole condivise che inducono le persone a comportarsi mediamente in modo affidabile. "Il sistema non è perfetto", nota ovviamente Schneier: "ci saranno sempre persone che abusano della nostra fiducia, ma il fatto che la maggior parte di noi sia affidabile per la maggior parte del tempo è sufficiente. [...] Le leggi e le tecnologie di sicurezza sono sistemi di fiducia che ci obbligano a comportarci in modo affidabile", consentendo società più grandi e complesse e permettendo la cooperazione tra sconosciuti.

Da qui in poi vi riporto in sintesi le parole chiarissime di Bruce Schneier, tradotte con il suo permesso. La traduzione integrale del suo saggio è disponibile presso Disinformatico.info.

A causa dell'ampiezza e della complessità della società, abbiamo sostituito molti dei rituali e dei comportamenti tipici della fiducia interpersonale con meccanismi di sicurezza che garantiscono affidabilità e prevedibilità, ossia la fiducia sociale. Ma poiché usiamo lo stesso termine "fiducia" per entrambi [i tipi], li confondiamo regolarmente. E quando lo facciamo, commettiamo un errore di categorizzazione. Lo facciamo continuamente: con i governi, con le organizzazioni, con i sistemi di tutti i tipi, e soprattutto con le aziende. Possiamo pensare a loro come amiche, quando in realtà sono servizi. Le aziende non sono morali; sono immorali, nella misura in cui la legge e la loro reputazione gliela fanno passare liscia.

Di conseguenza, le aziende si approfittano regolarmente dei loro clienti, maltrattano i loro lavoratori, inquinano l'ambiente e fanno pressioni per modificare le leggi in modo da poter fare queste cose ancora di più.

Sia il linguaggio che le leggi, dice Schneier, rendono facile commettere questo errore di categorizzazione. Usiamo la stessa grammatica per le persone e le aziende. Immaginiamo di avere rapporti personali con i marchi. Diamo alle aziende alcuni degli stessi diritti che diamo alle persone.

Alle aziende piace che commettiamo questo errore di categoria (lo commette anche Schneier, scherzosamente, usando questo concetto di piacere). Piace perché traggono profitto quando pensiamo a loro come amiche. Utilizzano mascotte e testimonial. Hanno account sui social media, e questi account hanno una propria personalità. Si riferiscono a loro stesse come se fossero persone. Ma non sono nostre amiche: le aziende non sono in grado di avere questo tipo di relazione.

Stiamo per commettere lo stesso errore di categorizzazione con le intelligenze artificiali: le considereremo nostre amiche quando non lo sono.

Ti invitiamo a leggere la pagina successiva di questo articolo:

La seduzione dell'IA, spiegata

|

Se questo articolo ti è piaciuto e vuoi rimanere sempre informato con Zeus News

ti consigliamo di iscriverti alla Newsletter gratuita.

Inoltre puoi consigliare l'articolo utilizzando uno dei pulsanti qui

sotto, inserire un commento

(anche anonimo)

o segnalare un refuso.

|

|

|

(C) by Paolo Attivissimo - www.attivissimo.net.

Distribuzione libera, purché sia inclusa la presente dicitura.

Commenti all'articolo (ultimi 5 di 22)

16-11-2024 15:35

10-11-2024 17:53

10-11-2024 16:14

Inserisci un commento - anche se NON sei registrato

|

|

||

|

- Al caffe' dell'Olimpo:

[GIOCO] Associazioni di idee - Motori di ricerca:

I motori di ricerca & la privacy - Tablet e smartphone:

Utilizzo smartphone - Internet - generale:

Come interagite con la IA? - Aiuto per i forum / La Posta di Zeus / Regolamento:

Avvisi risposte e notifiche MP non mi arrivano - Altra ferraglia stand-alone:

Android TV e smart TV - Sicurezza:

Abbonamento ad antivirus con prova gratuita - Programmazione:

Evoluzione di carriera: da Sviluppatore IBM i a

PM/Tech Lead - Windows 11, 10:

Comparsa di un Disco Locale sconosciuto - Linux:

Infloww su linux, si può?

Gladiator